Die Thermodynamik des Rechnens

Informationsverarbeitung braucht viel Energie. Sparsamere Computersysteme sollen das Rechnen effizienter machen. Doch die Effizienz dieser Systeme l?sst sich nicht beliebig steigern, wie ETH-Physiker nun zeigen.

Als im 19. Jahrhundert die Dampfmaschinen Verbreitung fanden, stellte sich schnell einmal die Frage, wie man diese Apparaturen optimieren k?nnte. Die physikalische Theorie, die aus dem Studium dieser Maschinen hervorging, die Thermodynamik, erwies sich in der Folge als ?usserst fruchtbarer Ansatz. Sie ist bis heute das zentrale Konzept, wenn man den Energieverbrauch von W?rme-Kraft-Maschinen optimieren will.

W?rme als kritische Gr?sse

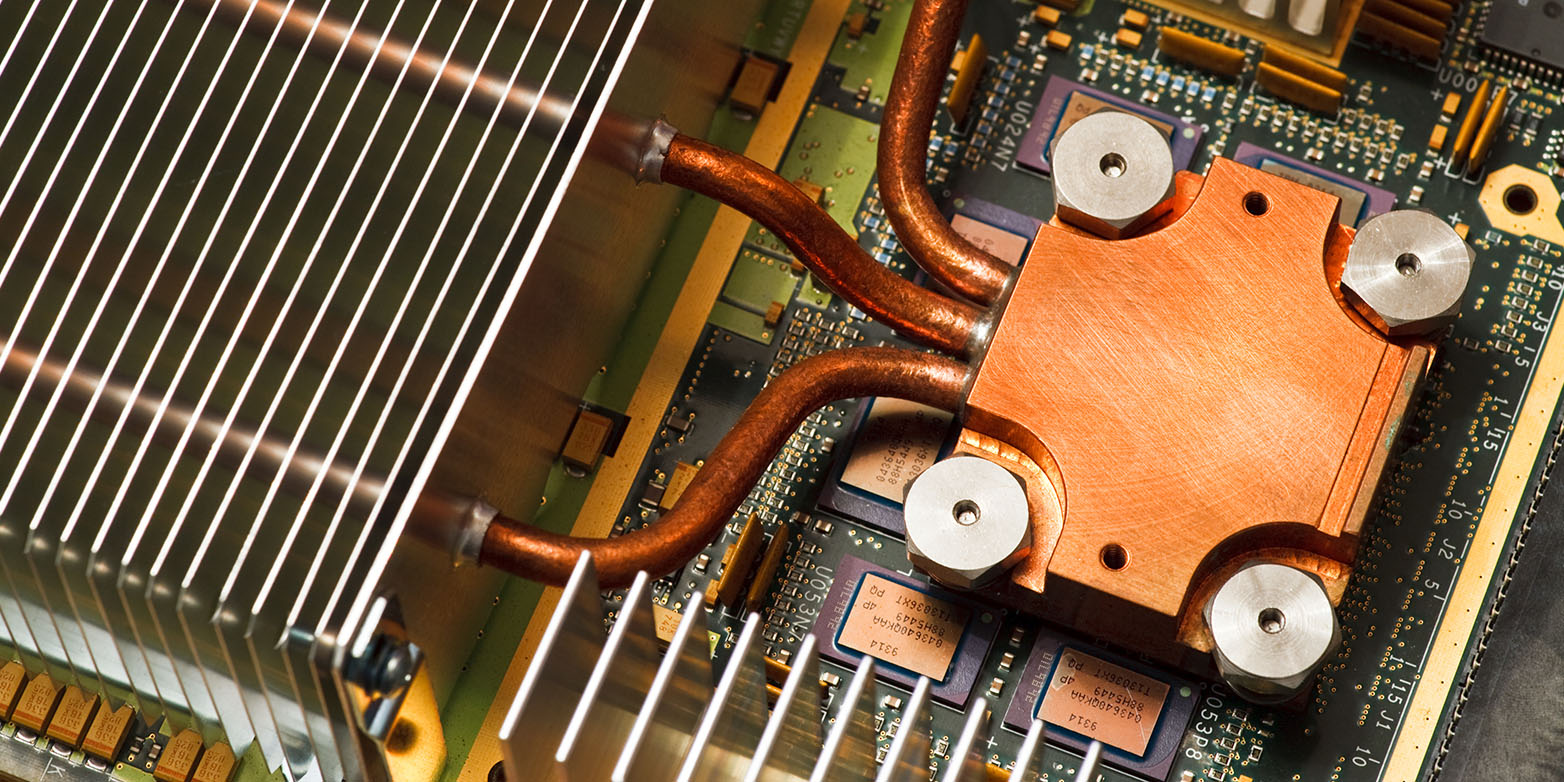

Auch im Informationszeitalter erhoffen sich die Physiker und Ingenieure nЈЙtzliche Beitr?ge von dieser Theorie. Denn immer deutlicher zeigt sich, dass nicht mehr die Taktfrequenz der Prozessoren und die Zahl der eingesetzten Chips die limitierenden Faktoren fЈЙr die Performance der Rechner sind, sondern der Energieumsatz. ?Die Leistungsf?higkeit eines Rechenzentrums h?ngt heute in erster Linie davon ab, wie viel W?rme abgefЈЙhrt werden kann?, bringt es Renato Renner, Professor fЈЙr Theoretische Physik und Leiter der Forschungsgruppe fЈЙr Quanteninformationstheorie, auf den Punkt.

Illustrieren l?sst sich Renners Aussage beispielsweise am Bitcoin-Boom: Nicht die Rechnerkapazit?ten an sich, sondern der exorbitante Energieverbrauch, der zu einer grossen W?rmeproduktion fЈЙhrt, und die damit verbundenen Kosten sind zum entscheidenden Faktor fЈЙr die Zukunft der Kryptow?hrung geworden. Auch in anderen Gebieten ist der Energiehunger der Rechner inzwischen ein nennenswerter Kostentreiber.

FЈЙr die Informationsverarbeitung stellt sich daher immer dr?ngender die Frage, wie man Rechenoperationen aus thermodynamischer Sicht m?glichst effizient erledigen kann ЈC oder anders gesagt: Wie lassen sich mit m?glichst wenig Energie m?glichst viele Rechenoperationen ausfЈЙhren? ?hnlich wie bei den Dampfmaschinen, KЈЙhlschr?nken und Gasturbinden geht es auch hier um ein fundamentales Prinzip: L?sst sich die Effizienz beliebig steigern oder gibt es ein physikalisch bedingtes Limit, das aus prinzipiellen GrЈЙnden nicht ЈЙberschritten werden kann?

VerknЈЙpfung von zwei Theorien

FЈЙr ETH-Professor Renner ist die Antwort klar: Ein solches Limit gibt es tats?chlich. Zusammen mit seinem Doktoranden Philippe Faist, der heute als Postdoc am Caltech arbeitet, zeigt er in einer Arbeit, die in diesen Tagen in der Zeitschrift ?Physical Review X? erscheint, dass sich die Effizienz der Informationsverarbeitung nicht beliebig steigern l?sst ЈC und zwar nicht nur in Rechenzentren bei der Berechnung von Wetterprognosen und der Verarbeitung von Zahlungseing?ngen, sondern auch in der Biologie, beispielsweise bei der Umsetzung von Bildern im Gehirn oder der Vervielf?ltigung von genetischen Informationen in den Zellen. Dabei zeigen die beiden Physiker auch auf, welches die entscheidenden Faktoren sind, welche fЈЙr die Begrenzung verantwortlich sind.

?Unsere Arbeit verknЈЙpft zwei Theorien, die auf den ersten Blick nichts miteinander zu tun haben: die Thermodynamik, welche die Umwandlung von W?rme in mechanische Arbeit beschreibt, und die Informationstheorie, die sich mit den Gesetzm?ssigkeiten der Informationsverarbeitung befasst?, erkl?rt Renner.

Dass es zwischen den beiden Theorien eine Verbindung gibt, l?sst sich zun?chst an einem formalen Kuriosum erahnen: In der Informationstheorie gibt es einen mathematischen Term, der formal der Definition der Entropie in der Thermodynamik gleicht. Dies ist der Grund, warum der Begriff Entropie auch in der Informationstheorie verwendet wird. Renner und Faist konnten nun zeigen, dass diese formale ?hnlichkeit offenbar tiefer reicht als man auf den ersten Blick vermutet.

Keine feste Grenze

Bemerkenswert ist, dass die Grenze der Effizienz, mit der Informationen verarbeitet werden k?nnen, offenbar nicht fix ist, sondern beeinflusst werden kann: Je besser man ein System versteht, desto genauer kann man zum Beispiel die Software auf das Chipdesign abstimmen und desto effizienter werden die Informationen verarbeitet. Genau dies wird heute beim Hochleistungsrechnen auch gemacht. ?ZukЈЙnftig werden die Programmierer auch die Thermodynamik des Rechnens berЈЙcksichtigen mЈЙssen?, ist Renner ЈЙberzeugt. ?Entscheidend ist nicht, die Zahl der Rechenoperationen zu minimieren, sondern Algorithmen einzusetzen, die m?glichst wenig Energie verbrauchen.?

Als Massstab fЈЙr die Entwickler k?nnten auch hier biologische Systeme dienen: ?Man weiss aus verschiedenen Untersuchungen, dass unsere Muskeln aus thermodynamischer Sicht sehr effizient funktionieren?, erkl?rt Renner. ?Nun w?re es natЈЙrlich interessant zu wissen, wie gut unser Gehirn bei der Verarbeitung von Signalen abschneidet.?

M?glichst nahe am Optimum

Dass sich Renner als Quantenphysiker mit diesen Fragen auseinandersetzt, ist kein Zufall: Mit der Quanten-Thermodynamik ist in den letzten Jahren ein neues Forschungsfeld entstanden, das insbesondere fЈЙr den Bau von Quantencomputern grosse Relevanz hat. ?Man weiss, dass die sogenannten Qubits, mit denen kЈЙnftige Quantenrechner rechnen werden, nahe am thermodynamischen Optimum arbeiten mЈЙssen, um die sogenannte Dekoh?renz zu verz?gern?, berichtet Renner. ?Dieses Ph?nomen ist ein grosses Problem bei der Konstruktion von Quantencomputern, denn es verhindert, dass quantenmechanische ?berlagerungszust?nde genЈЙgend lange aufrecht erhalten werden k?nnen, um sie fЈЙr Rechenoperationen zu nutzen.?

Literaturhinweis

Faist P, Renner R: Fundamental work cost of quantum processes. Physical Review X, 2018, doi: externe Seite 10.1103/PhysRevX.8.021011