Präzise Touchscreens dank KI

Weniger Tippfehler beim Berühren einer Smartphone-Tastatur: Informatiker der ETH Zürich haben eine neue KI-L?sung entwickelt, dank der Touchscreens Berührungen mit einer achtmal h?heren Aufl?sung erkennen k?nnen. Zudem l?sst sich viel genauer herleiten, wo Finger den Bildschirm berühren.

Das kennen wohl alle von uns: wer schnell eine Nachricht auf dem Smartphone eintippen will, trifft auf der kleinen Tastatur – oder auf anderen Elementen der Benutzeroberfl?che – mitunter die falschen Buchstaben. Das liegt nicht nur an uns, denn die Berührungssensoren, die das Eingeben per Finger auf dem Berührbildschirm (engl. touch screen) erfassen, haben sich seit ihrer Einführung Mitte der 2000er-Jahre nicht wesentlich ver?ndert.

Im Unterschied zu ihren Berührungssensoren erreichen die Bildschirme von Smartphones und Tablets mittlerweile eine nie dagewesene visuelle Qualit?t, die mit jeder neuen Ger?te-Generation noch deutlicher zu sehen ist: h?here Farbtreue, h?here Aufl?sung, sch?rferer Kontrast. W?hrend ein iPhone-Telefon der neuesten Generation zum Beispiel eine Display-Aufl?sung von 2532x1170 Pixeln hat, kann dessen Berührungssensor nur Eingaben mit einer Aufl?sung von etwa 32x15 Pixeln erkennen – das ist fast 80-mal niedriger als die Bildschirmaufl?sung: ?Und da fragen wir uns, warum wir auf der kleinen Tastatur so viele Tippfehler machen? Wir denken, dass wir in der Lage sein sollten, Objekte mittels Berührung pixelgenau auszuw?hlen, aber das ist nicht der Fall?, sagt Christian Holz, ETH-Informatikprofessor vom Sensing, Interaction & Perception Lab (SIPLAB) in einem Interview der Reihe ?Spotlights? des ETH-Informatikdepartements.

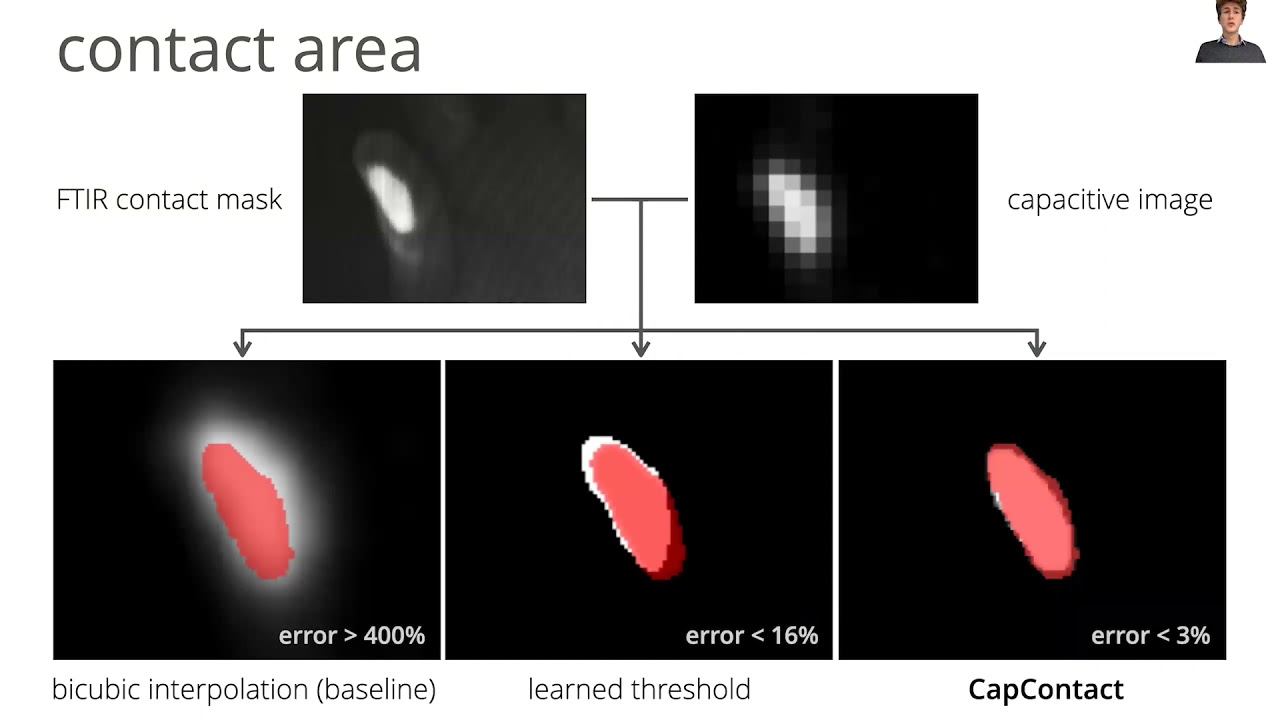

Mit seinem Doktoranden Paul Streli hat Holz eine künstliche Intelligenz (KI) namens ?CapContact? entwickelt, die superaufl?sende Touchscreens erm?glicht. Diese k?nnen die Kontaktfl?che, wo sich Finger und Bildschirm-Oberfl?che tats?chlich berühren, zuverl?ssig und deutlich genauer als heute üblich erkennen. In dieser Woche haben sie ihre neue KI-L?sung an der externe Seite CHI 2021, der Fachkonferenz für menschliche Faktoren in Computersystemen, vorgestellt.

Erkennen, wo Finger den Screen berühren

Entwickelt haben die ETH-Forscher die KI für sogenannte kapazitive Touchscreens, also die Art von Bildschirmen, die in jedem unserer Handys, Tablets oder Laptops existiert: Bei diesen Berührungsbildschirmen erkennen die Sensoren die Position der Finger jeweils daran, dass sich das elektrische Feld zwischen den Sensorleitungen durch die N?he eines Fingers ?ndert, wenn dieser den Bildschirm berührt. Berührungsbildschirme machen sich dabei die Eigenschaft zunutze, dass die Intensit?t einer ?Berührung? mit zunehmender Entfernung der Finger exponentiell abnimmt. Jedoch k?nnen sie den jeweils tats?chlichen physikalischen Kontakt mit der Oberfl?che nicht erkennen.

Die kapazitive Sensorik sei nie dafür entwickelt worden, um punktgenau herzuleiten, wo auf dem Bildschirm tats?chlich eine physikalische Berührung stattfinde, sagt Holz: ?Sie erkennt nur die N?he unserer Finger.? Die Touchscreens heutiger Ger?te errechnen somit die Position, wo die Eingabe mit dem Finger erfolgt, aus grob aufgel?sten N?herungsmessungen. Die Forscher mussten einerseits die geringe Aufl?sung der Sensoren erh?hen, anderseits mussten sie herausfinden, wie man aus den kapazitiven Messungen pr?zise auf den jeweiligen Kontaktbereich zwischen Finger und Bildschirmoberfl?che schliessen kann.

Dazu verwenden Streli und Holz, anders als bisher üblich, Touchscreens als Bildsensoren. Ein Berührbildschirm ist laut Holz im Grund eine sehr niedrig aufl?sende Tiefenkamera, die etwa acht Millimeter weit blicken kann. Eine Tiefenkamera nimmt nicht direkt Fotos auf, sondern kodiert die N?he von Objekten im Sichtbereich. Mit ?CapContact? nutzen die Forscher diese Einsicht aus, um durch ihre neuentwickelte KI-Methode die physikalische Kontaktfl?che zwischen dem Finger und dem Display hochaufl?send abzusch?tzen.

?Erstens errechnet ?CapContact? die tats?chlichen Kontaktfl?chen zwischen Fingern und Touchscreens bei einer Berührung?, sagt Holz, ?zweitens errechnet sie diese Kontaktfl?chen mit der achtfachen Aufl?sung aktueller Berührungssensoren, wodurch unsere Touch-Ger?te die Berührungen viel pr?ziser erkennen k?nnen.?

Um die KI zu trainieren, haben die Forscher ein spezielles Ger?t entwickelt, das die kapazitiven Intensit?ten, also die Beinahe-Berührungen, und die echten Kontaktkarten durch einen hochaufl?senden Drucksensor aufzeichnet. Indem sie die realen Berührungen von vielen Test-Teilnehmenden erfassten, erhielten die Forscher Trainingsdaten, mit denen ?CapContact? lernte, superaufl?send die Kontaktfl?chen aus den groben, niedrig aufgel?sten Sensordaten heutiger Touchscreens vorherzusagen.

Niedrige Aufl?sung als Fehlerquelle

?In unserem Beitrag zeigen wir, dass wir aus der von ?CapContact? berechneten Kontaktfl?che zwischen Finger und Handy-Bildschirm viel genauer die Position der Berührungseingabe herleiten k?nnen als dies aktuelle Ger?te verm?gen?, erg?nzt Paul Streli. Zudem zeigen die Forscher, dass ein Drittel der Fehler aktueller Ger?te darauf zurückzuführen ist, dass die Eingabeabtastung nur mit niedriger Aufl?sung erfolgt. ?CapContact? beseitigt diese Fehler mit maschinellem Lernen (Deep Learning).

Die Forscher weisen nach, dass ?CapContact? die Berührungsfl?chen auch dann zuverl?ssig erkennt und auseinanderh?lt, wenn Finger sehr nahe beieinanderliegend den Bildschirm berühren. Das ist zum Beispiel bei der Pinch-Geste so, bei der man Daumen und Zeigefinger über einen Bildschirm bewegt, um Texte oder Bilder zu vergr?ssern. Diese Berührung k?nnen heutige Ger?t kaum unterscheiden. In einem Experiment setzten die Forscher zudem Sensoren ein, die viel niedriger aufgel?st waren als die, die man heute in Handys einbaut – trotzdem erkannte ?CapContact? die Berührungen besser und konnte die Kontaktfl?chen deutlich genauer herleiten als Handys mit der heute üblichen Aufl?sung. Die Chance, dass diese KI-L?sung den Grund legt für eine neue Berührungserkennung in künftigen Handys und Tablets stehen damit gut.

Um Nachfolgearbeiten in dem Bereich zu erm?glichen, ver?ffentlichen die Forscher sowohl s?mtliche trainierten Deep Learning-Modelle und Quelltexte als auch den aufgenommenen Trainings-Datensatz auf ihrer externe Seite Projektseite.

Literaturhinweis

Streli, P, Holz, C. CapContact: Super-resolution Contact Areas from Capacitive Touchscreens. CHI '21: Proceedings of the 2021 CHI Conference on Human Factors in Computing Systems, May 2021, Article No.: 289, Pages 1–14. DOI: externe Seite 10.1145/3411764.3445621.